人工智能的未來

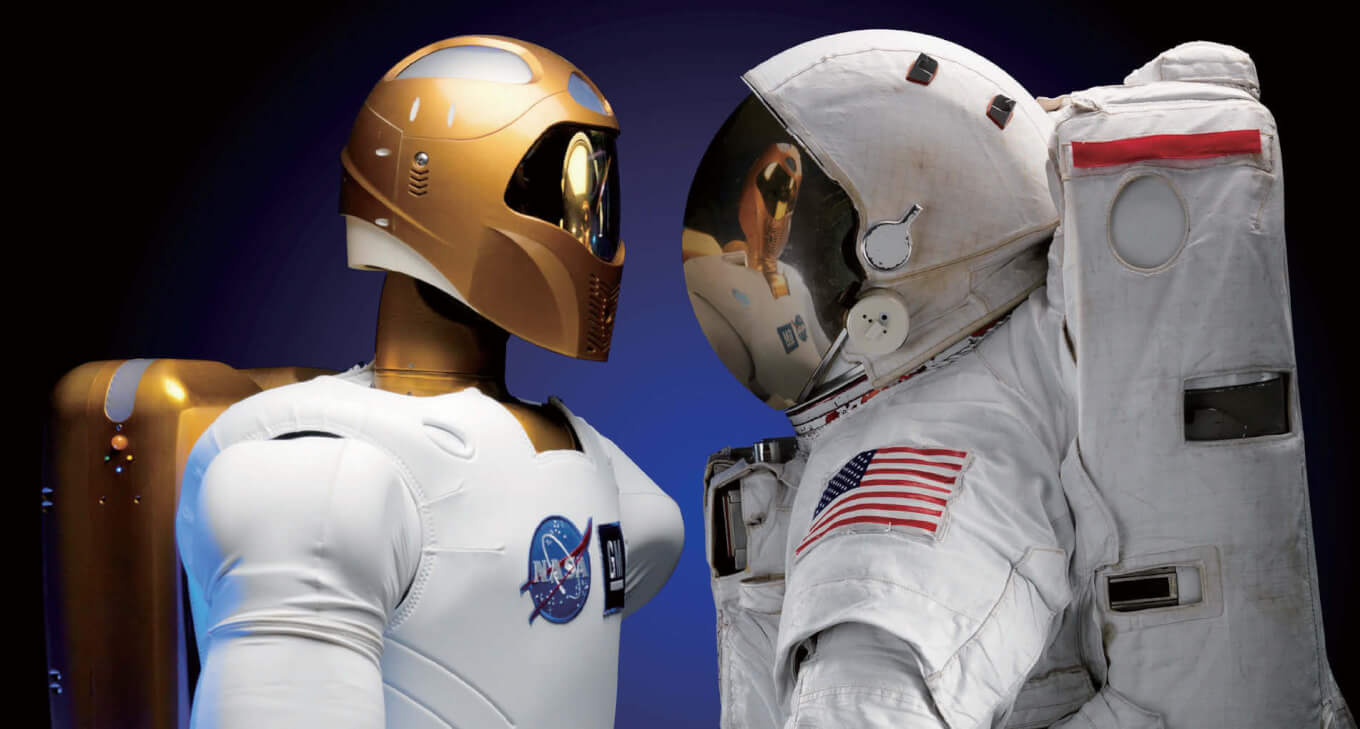

機器人的興起,它會繼承地球嗎?當機器人有了意識,不再只是生產、醫療、生活、交通的人類助手,一場人類與機器人的代理人之爭,將如何展開?在2030 年甚至2100 年人與機器將會決戰或互融?

文/加來道雄(科學家)

神話中的諸神,可以用神力使沒有生命的東西活起來。依據《聖經.創世紀》中所言,上帝以塵土創造了男人,然後「將生氣吹在他鼻孔裡,他就成了有靈的活人」。依據希臘羅馬神話,女神維納斯(Venus )讓雕像有了生命。藝術家畢馬龍(Pymalion )因愛上自己的雕像作品而深感無助,維納斯很同情,特許他實現願望,將雕像變成美女加拉蒂雅(Galatea)。火神(Vulcan,天神的鐵匠)甚至可以創造一群金屬製造的機械僕人,並賦予生命。

今天,我們就像是火神,在實驗室中打造機器。我們並非對著泥土吹氣,而是對著鋼鐵和矽吹氣。但它會使人類獲得自由或使人類變成奴隸?如果有人閱讀現在的報紙大標題,彷彿已經有了答案:人類將要迅速地被我們的創造物超越。

人類的終結?

《紐約時報》曾有個大標題,表達了對人類終結的焦慮:「科學家擔憂機器會比人類聰明。」全世界頂尖的人工智能領袖們,2009 年曾於加州的阿西洛馬城(Asiloma )集會,正式討論機 器人接管的後果。如同電影中的情節,與會代表追問許多問題,像是:如果機器人變得跟你的配偶一樣聰明,會發生什麼事?

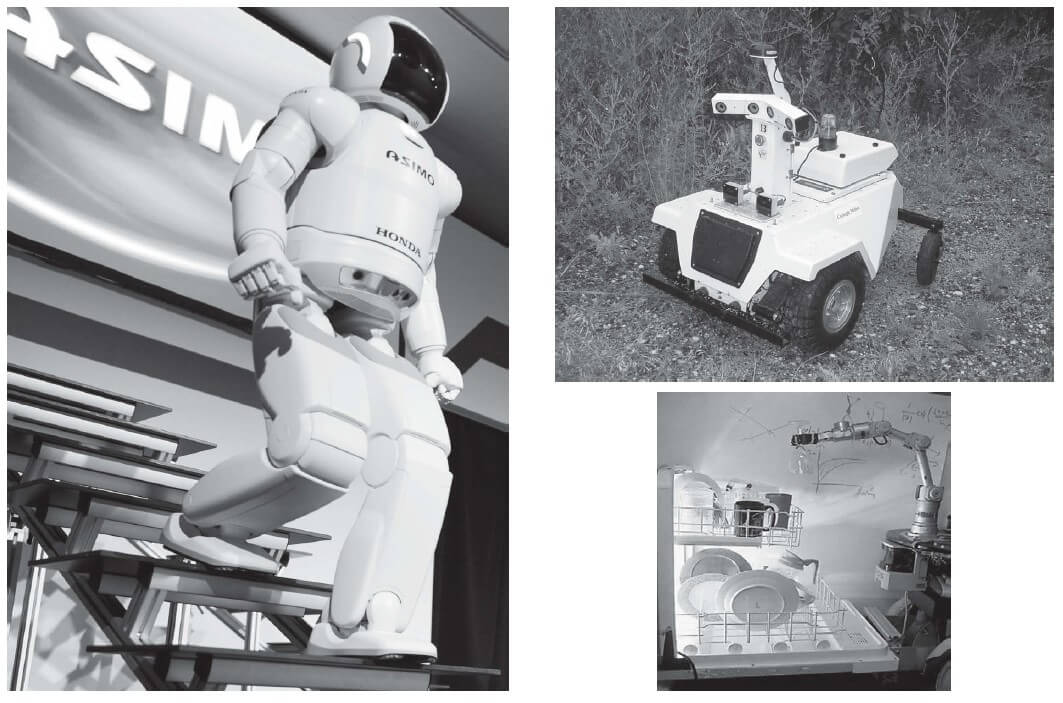

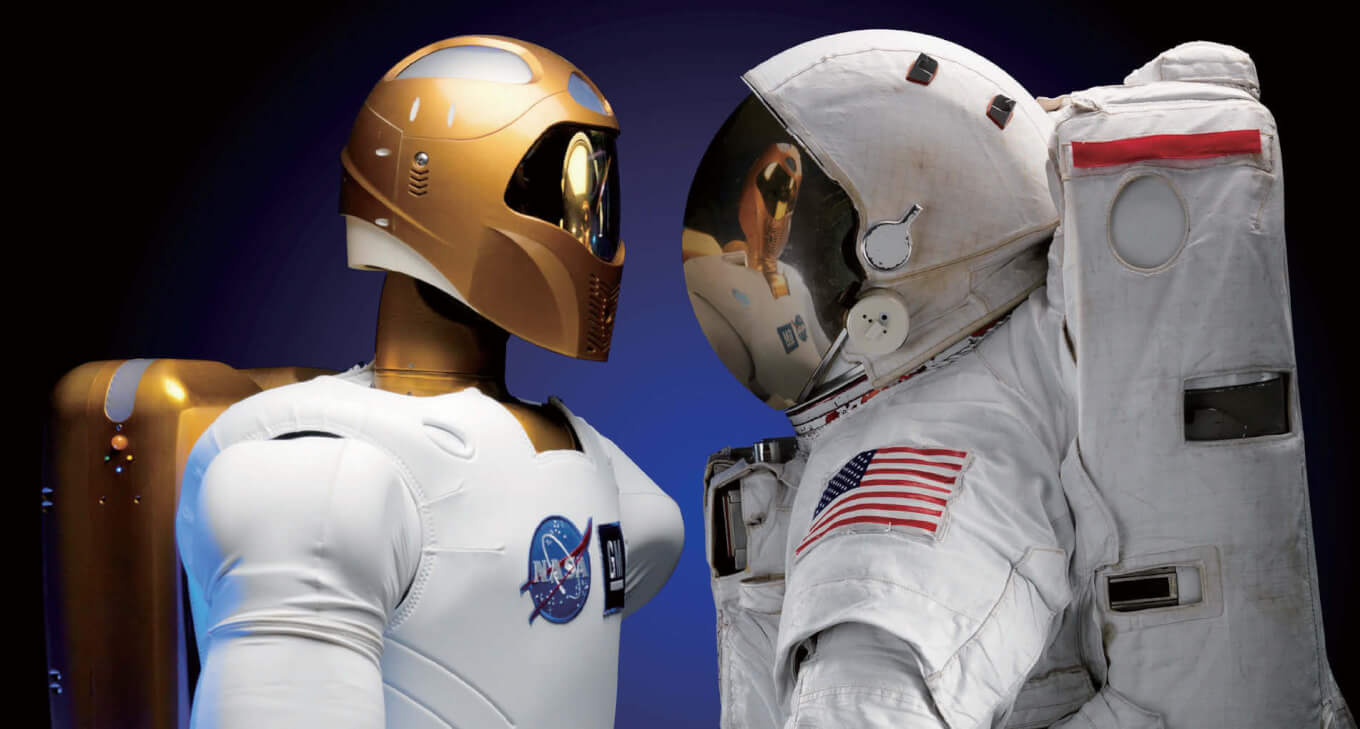

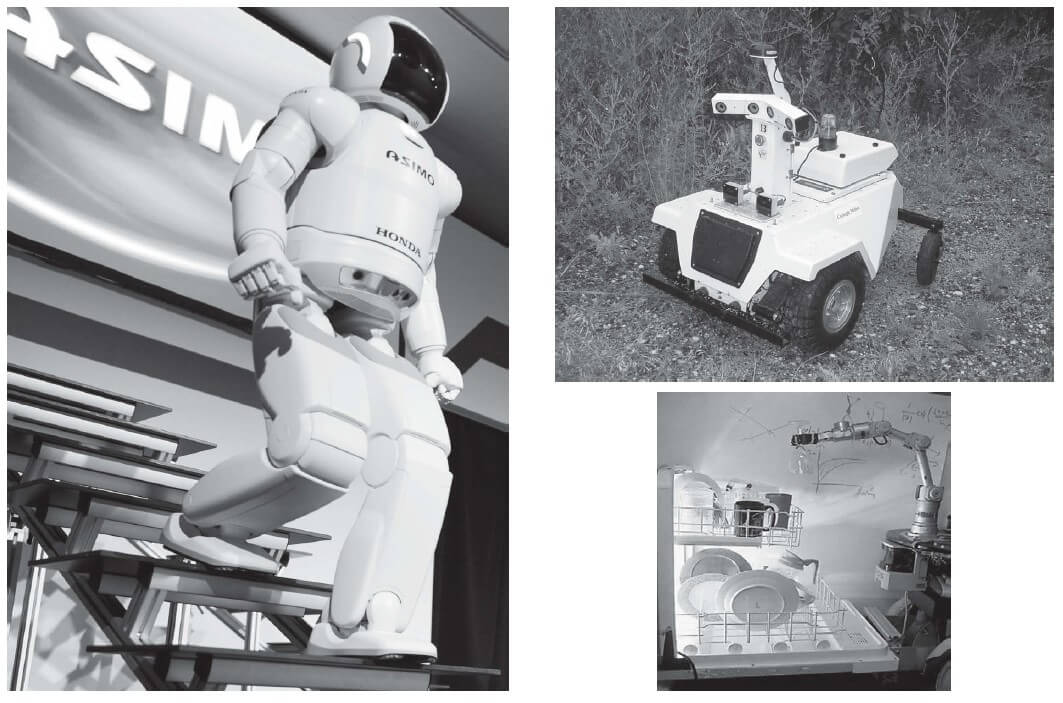

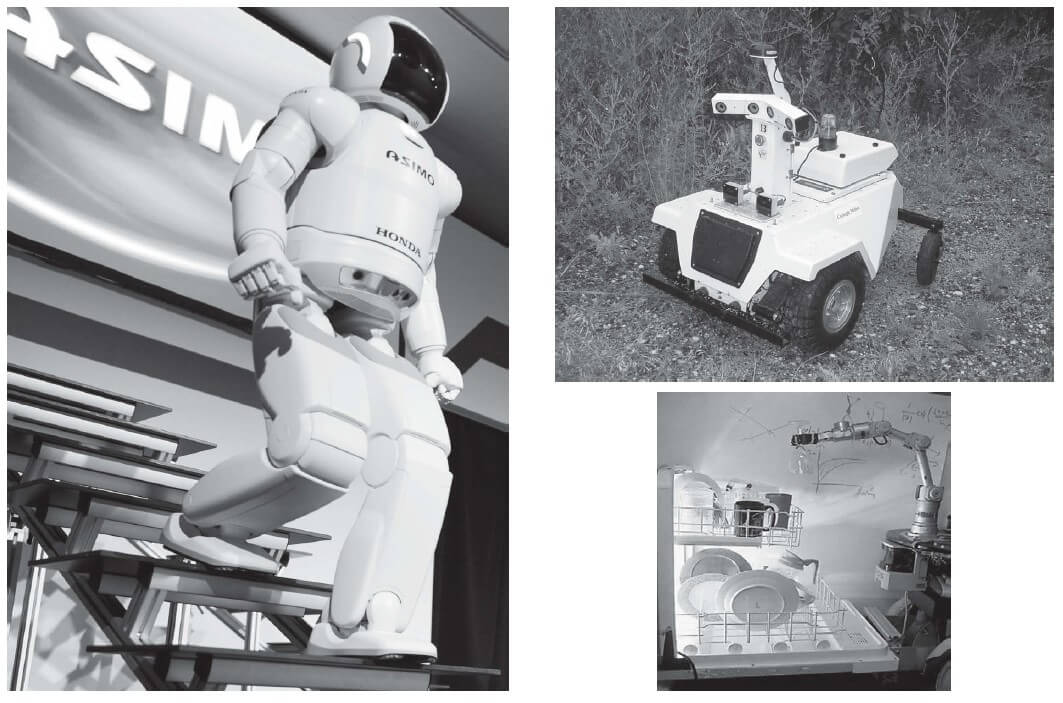

作為此一機器人革命的有力證據,人們指向「掠食者」無人駕駛飛機(它正在阿富汗與巴基斯坦,以致命的正確性瞄準恐怖分子)、自動駕駛汽車、本田機器人阿西莫(ASIMO, Advanced Step Inovative Mobility,意即高級步行創新移動機器人) —世界最先進能走、跑、爬樓梯、跳舞甚至端咖啡的機器人。

會議發起人之一,微軟公司的艾瑞克.賀維茲(Eric Horvitz ),提到會議進行時的激情洋溢,他說:「科技正在提供近乎宗教的遠景,而他們的想法引起了如同狂喜(Rapture )般的共鳴。」

同一個夏天,螢幕上最熱門的電影似乎擴大了這個啟示圖。在《魔鬼終結者:未來救贖》(Terminator Salvation )中,一群人類的烏合之眾與占領地球的機器怪獸奮戰。在《變形金剛:復仇之戰》(Transformers: Revenge of the Fallen )中,未來的外太空機器人,以人類為他們星際戰爭的士兵,並以地球為戰場。在《獵殺代理人》中,人們寧可變成完美、漂亮的超人機器去過生活,也不願面對他們老化、衰退的肉體。

由報紙的大標題和戲院的公布片名大招牌來判斷,似乎人類要吞下最後一口氣的時機已經迫在眉睫。人工智能的專家正在嚴肅的問:我們是否會有一天,必須像動物園裡的熊,當我們創造的機器人對著我們丟花生時,我們就要在欄柵後面跳舞?或者,會變成我們的創造物的寵物狗嗎?

但是,仔細檢驗,實情並非如此。沒錯,過去十年的確有很多重大的突破,但是我們應當從正確的角度來看。

二十七英尺長、能夠從空中對恐怖分子發射致命火箭的「掠食者」無人駕駛飛機,是由人類以搖桿控制。這個人類,很可能是年輕的電動遊戲老手,舒服地坐在電腦螢幕後面選擇他的目標。是這個人類,而非「掠食者」,發動射擊。而自動駕駛的汽車,在掃描地平線並轉動駕駛盤時,並非獨立做決定;它們是依據儲存在記憶體中的全球定位系統地圖前進。所以那個全自動、有意識而且兇殘的機器人,仍然還在遙遠的未來。

我們並不意外,雖然媒體聳動地報導,阿西洛馬城會議的某些較為聳人聽聞的預測,多數平日從事人工智能研究的科學家,則較為保守和小心。當他們被問及機器何時會比人類聰明時,科學家們提出的答案非常分歧,從二十年到一千年都有,實在令人訝異。

所以,我們必須區分將兩種不同類型的機器人。第一類型是由人或程式遙控,預先像錄音帶一般擬好劇本,依循精確的指令行動。這些機器人已經存在,也有過很多報導。它們慢慢地進入家庭以及戰場。但如無人類做決定,他們基本上只是一堆廢物。所以這些機器人不應與第二類型的機器人搞混。第二類型機器人真正自主,無須人類輸入的資訊就能自行思想。在過去的半個世紀,正是這種自主的機器人使科學家感到困惑。

阿西莫機器人

人工智能的研究人員往往會指著本田公司的阿西莫機器人圖片,來介紹機器人革命的進展。它身高四英尺三英吋,體重一百一十九磅,看起來像個男孩戴著黑面罩頭盔,並背著背包。阿西莫的確成就非凡:它真的會走路、會跑、會爬樓梯和說話。它可以在房間裡走來走去,拿起杯盤,回應一些簡單的指令,還記得一些面孔。它甚至記得很多字彙,可以說不同的語言。阿西莫是由數十個本田科學家辛勤工作二十年的成果。他們締造了工程的奇蹟。

在兩個不同的場合,我在主持 BBC 的特別科學節目時,有榮幸在會議中與阿西莫互動。當我與它握手時,它的反應完全與人類的方式一樣。我對它揮手,它也立刻對我揮手。當我對它說話,請它拿一點果汁給我時,它轉頭以怪異的人類步伐走向飲料桌。的確,阿西莫談話的時候,很像是個有生命的個體。我幾乎就想要請機器人取下頭盔,看看聰明地躲在裡面的孩子。它甚至比我還會跳舞。

乍看之下,阿西莫似乎很聰明,能夠對人類的指令做出反應、進行對話、並在房間內走動。但實情並非如此。當我在電視攝影機前與阿西莫互動時,每一個動作和細節,都要經過小心安排。事實上,僅僅和阿西莫拍攝五分鐘的簡單場景,就花了大約三小時。雖然如此,每拍完一個場景之後,仍然需要一個阿西莫的操控團隊拿著膝上型電腦,匆忙地為機器人重新編訂程序,它就像是一個錄音機在播放預先錄製的訊息,只是按照人類所寫的指令做出動作。雖然阿西莫每年都會變得更加精緻,它還是無法獨立思考。它的每一句話、每一個姿勢和每走一步,都必須由操控人員小心演練。

其後,我與阿西莫的發明人之一,有過一次坦誠的交談。他承認,阿西莫能像人類的行動雖然令人印象深刻,但它的智力只有昆蟲的水準。它的大多數動作,必須事前以程式設定。它可以活生生地走路,但它的行進路線卻須小心設定,否則它就會撞上傢具,因為它無法真正認得房間內的東西。

相較之下,連蟑螂都認得東西,匆匆繞過障礙,尋找食物和同伴,躲避捕食者,計畫複雜的逃亡路線,躲藏在陰影中,然後消失在裂縫裡。這些都發生在數秒間。

布朗大學人工智能研究人員湯馬士. 狄恩(Thomas Dean )承認過,他所製造的行動緩慢的機器人,「還處在有力氣走過大廳,而不在水泥地上留下痕跡的階段」。如同我們以後會見到的,現在最強大的電腦只能模擬老鼠的神經,而且只有幾秒鐘。若要機器人跟老鼠、兔子、狗或貓(然後是猴子)一樣聰明,還需要數十年的努力。

人工智能的歷史

批評家有時候會指出一個固定模式:每三十年,就會有人工智能的從業人員聲稱,超級智慧機器人即將降臨,然後經過實際檢驗,招來反撲。

在1950 年代,電子計算機於第二次世界大戰後首次發表,科學家迷惑大眾說,機器人可以表現奇蹟似的技藝:拿起積木、下西洋棋,甚至解決幾何問題。彷彿真正的聰明機器馬上就要來了。群眾都大感驚奇。很快地,又有雜誌刊出文章,令人屏息以待地預測,機器人將要進入每一個人的廚房、做晚飯或清掃房間。在1965 年,人工智能先驅赫伯特.西蒙(Herbert Simon )聲稱,「在二十年內,機器人將能做任何我們會做的工作。」但接下來的現實是,下棋機器贏不了人類專家,它們只是會下棋而已,別的都不會。這些早期的機器人,像是早期馬戲團中只會一招的小馬,玩不出新把戲。

事實上,在1950 年代,人工智能的確有所突破,但因它的進展被過度誇張和宣揚,於是引來反撲。1974 年,在批評者的聯合反對下,美國和英國政府切斷經費補助。人工智能的第一個寒冬降臨。

現在,人工智能研究人員保羅.阿布拉罕( Paul Abraham )搖著頭回顧1950 年代那令人心醉的時代,當時他還是麻省理工學院的研究生,似乎任何事情都辦得到。他回憶說:「那就如同有一群人計畫建造一座高塔通往月球,他們都會驕傲地指著藍圖說,今年的塔比去年的高了多少。唯一的困難是,月球並未變得更接近些。」

在1980 年代,人工智能的熱情又登上高峰。這次五角大廈投入數以百萬計的經費,支持諸如可以深入敵後、偵查敵情、解救美軍然後自行返回總部的智慧卡車計畫。日本政府國際貿易與工業部甚至全力支持一個雄心勃勃的「第五代電腦系統計畫」(Fifth Generation Computer Systems Project )。這個計畫的目標之一是:造出可以會話、有完全的推理能力,並且猜透我們心裡願望的機器人。所有的目標都要在1990 年代達成。

不幸地,智慧卡車唯一辦到的事情就是走丟了。而第五代電腦在許多誇耀之後,沒有任何解釋就悄悄地放棄了。美好的空言又再度超越了現實。事實上,1980 年代的人工智能的確有真正的進展,但因進步被過度宣揚,所以二度反撲又來了,造成了第二個人工智能寒冬。這期間,補助款用盡了,理想幻滅的科技人成群地離開了。人們痛苦地明白,這其中還缺少了某種東西。

1992 年,人工智能研究人員為電影《2001太空漫遊》( 2001: A Space Odyssey )舉辦特 別慶祝會時,他們的心情很複雜。在電影中,一台命名為「HAL 9000」 的電腦發狂了,也屠殺了 太空船的航員。這支1968 年拍攝的電影也預測,到了1992年,將會有能就任何主題與任何人進行流利對話的機器人,而且它還能指揮太空船。不幸地,最先進的機器人的聰明程度,連一隻昆蟲都沒得比,事實顯然讓人深感挫折。

1997 年 IBM 的機器人「深藍」(Deep Blue )在關鍵性的比賽中擊敗了世界棋王蓋瑞. 卡斯帕洛夫( Garry Kasparov ),達成了歷史性的突破。「深藍」是一個工程奇蹟,每秒運算 一百一十億次。不過,它並沒有打開人工智能研究的大水閘,啟動一個新時代,結果恰恰相反。它只是凸顯出人工智能原始狀態。很多人反思的結果,都認為「深藍」無法思考。它的棋藝的確高超,但在 IQ 測驗中卻可能抱鴨蛋。在這個勝利之後,出面對媒體發表所有的談話的,卻是輸家卡斯帕洛夫,因為「深藍」完全無法談話。人工智能研究人員,很不情願地開始領會一個事實:強大的電腦的運算力並不等同於智能。人工智能學者理查.黑克勒(Richard Heckler )說:「今天,你 可以花四十九美元買到可以打敗世界冠軍的西洋棋程式,但沒有人會說它們有智能。」

隨著摩爾定律每十八個月推出新一代電腦,過去悲觀的一代,遲早會被漸漸地遺忘,聰明又熱情的新一代將取而代之,在一度冬眠的領域重新創造新生的樂觀和活力。在最後一期人工智能寒冬降臨三十年後的今天,電腦已經夠進步,足以讓新一代的人工智能研究人員,再對未來提出充滿希望的預測。它的支持者說,人工智能的時代終於來臨了。這次,是真的。事不過三,第三次嘗試應是一個幸運符。但如果他們說對了,那麼人類會很快地被淘汰嗎?

大腦是數位電腦嗎?

如同數學家現在所認識到的,根本的問題在於,他們在五十年前造成一個關鍵性的錯誤,以為大腦可與大型數位電腦做類比。但令人懊喪的是,大腦顯然並非如此。大腦沒有典型電腦所含有的奔騰(Pentium)晶片、視窗作業系統、應用軟體、中央處理器(CPU )、程式以及子程式。事實 上,數位電腦的結構與大腦的構造完全不同。大腦有點像是學習機器,一個神經元的集合體,每學習一件作業,它就立刻重新連結。(個人電腦則完全無法學習。你的電腦,今天只會跟昨天一樣笨。)

所以,我們至少可用兩種模式來研究大腦。第一種,傳統的由上而下的模式,將機器人視同數位電腦,從一開始就將所有的智能規則寫入程式。至於數位電腦,則可以切割成某種被稱為「圖靈機」(Turing machine )的裝置—那是偉大的英國數學家艾倫.圖靈(Alan Turing )介紹的一種假 設性的裝置。圖靈機包含三個基本部分:輸入、消化資料的中央處理器以及輸出。所有的數位電腦都以這個簡單模式為基礎。這種方式的目標是將所有的智能規則編碼裝進一片光碟中。將這個光碟片塞進電腦,它就突然活了過來,變得有智能。所以,這個神祕的光碟包含創造智能機器所需的所有軟體。

不過,我們的大腦完全沒有作業程式或軟體。它比較像是一個「神經網絡」,一堆雜亂的、不斷重新互相連結的神經元的複合體。神經網絡遵循「海柏學習法則」(Hebb’s rule ):每作一次正確決定,那些神經通路就獲得增強。只要在每次它成功地執行一個工作後,改變某些神經元之間的連結強度,此一增強就已完成。(海柏學習法則能用這個老掉牙的問題來表達:音樂家要如何取得前往卡內基音樂廳演奏的邀請?答案:練習、練習、再練習。對神經網絡來說,練習可以達到完美。海柏學習法則也可以解釋,壞習慣之所以難以打破,因為這個壞習慣的神經通路已經根深蒂固。)

神經網絡植基於「由下而上」的模式。它不是被所有的智能規則填滿的,而是以嬰兒學習的方法得到,跌跌撞撞,遇到很多事物,在經驗中學習。神經網絡並未被灌滿程式,而是用老舊的方法,通過艱苦的生活磨練來學習。

神經網絡的結構與數位電腦完全不同。如果你把數位電腦中央處理器中的一個電晶體取出,電腦就會失靈。不過,如果你取出大腦中的某一部分,它仍然可以用其他部分取代失去的部分,繼續運作。還有,要具體指出數位電腦「思考」的正確位置是有可能的:就是中央處理器。但是,人類大腦的掃描明確顯示,思想活動遍及大腦的大部分。不同部門以精確的次序亮起,思想彷彿乒乓球在到處跳動。

數位電腦能夠以接近光速運算。相對的,人類大腦速度之慢,令人難以置信。神經衝動以極為緩慢的速度移動(約每小時二百英里)。但是大腦的彌補作用遠遠超過需要,因為它進行大量平行處理。也就是說,它有一千億個神經元同時在運作,每一個只執行一小部分的運算,每一個神經元又與其他一萬個神經元相連。在某一比賽中,單一超快的處理器,被超慢的平行處理器遠遠拋在後面。(這使我們想起一個古老的趣味謎語:如果一隻貓一分鐘可以吃一隻老鼠,那麼一百萬隻貓要吃一百萬隻老鼠需要多久?答案:一分鐘。)

還有,大腦並非數位。晶體是以閘門的開關代表零與一。神經元也是數位化(可以工作或不工作),但它們也可以類比化,既傳送連續訊號,也傳送斷續訊號。

機器人的兩個問題

僅僅舉出電腦的兩個較引人注目的限制(相較於人類大腦),我們就可以領會到,為什麼電腦無法達成人腦不費吹灰之力就能達成的兩項關鍵性工作:模式辨識(pattern recognition )和常識判斷力。這兩個問題使過去半世紀的努力無解。這是為什麼我們沒有機器女僕、男管家和祕書的主要理由。

第一個問題是模式辨識。機器人的視力遠遠超過人類,但他們無法了解看到的是什麼。當一個機器人走進室內,它將影像轉換成一堆小點。透過處理這些小點,它可以辨認出線、圓圈、方塊和三角形的集合。然後機器人嘗試去為這堆小點與儲存在記憶體中的物體一對一配對—這種工作也稱得上冗長乏味,連電腦也不例外。經過數小時計算之後,機器人也許能將這些線條和椅子、桌子及人配對。相對的,當我們走進一個房間,不到一秒鐘,我們就能認識椅子、桌子、書桌和人。事實上,我們的大腦主要就是一個模式辨識的機器。

第二,機器人沒有常識判斷力。雖然它們的聽力比人類好太多,但他們不了解聽到的是什麼。舉例來說,想想下列陳述:

*孩子喜歡獎賞,而非處罰。

*線能拉不能推。

*手杖能推不能拉。

*動物不能說英語,也無法理解英語。

*旋轉使人感覺頭暈。

對我們而言,這些陳述只是普通常識,但機器人則不然。沒有任何一條邏輯或程式證明線能拉不能推。我們已經在經驗中學到這些「顯然的」陳述的真相,不是因為它們被程式置入記憶。

由上而下的模式的問題在於,若要模仿人類的思考,光是普通常識就需要太多行的編碼。例如,如果要描寫六歲孩子所知的常識規則,需要花費數億的編碼。卡內基梅隆大學人工智能實驗室前主任漢斯.莫拉維克(Hans Moravec )嘆口氣說:「到今天,人工智能程式仍無法展示少量的常識—例如,當一個醫療診斷程式去處理一台壞掉的自行車時,可能會開出抗生素的處方,因為這個程式裡沒有辦法分辨人、疾病或自行車的概念。」

不過,某些科學家堅信,只要靠蠻力,就能掌握常識。他們覺得,一個新的曼哈頓計畫(與製造原子彈的計畫同名),一定可以解決常識問題。這個打算創造「思想百科全書」的蠻幹計畫,被稱為CYC,從1984 年開始。這個計畫打算將常識的祕密編成代碼寫進單一程式,它將是人工智能成就的冠冕。不過,經過數十年的辛勤工作,這個 CYC 計畫無法實現目標。

CYC 計畫的目標很簡單:「在2007年以前,掌握一億件事物,約等於一個典型的人在2007年對世界所知的全部。」但那個截止期限,以及在此之前設定的好幾個期限,都已經跳票。 每一個 CYC 工程師所設下的里程碑,都已成過去式,但是沒有一個科學家曾對掌控智能的本質有所進展。

人與機器對決

我曾有機會在一個機智競賽中,與麻省理工學院托馬叟.波吉歐(Tomaso Poggio )製造的機器 人對決。雖然機器人無法像我們一樣辨識簡單的模式,波吉歐卻能創造出一個程式,可以在某一特殊領域運算得跟人一樣快。這個領域是所謂的「即時辨識」,就算事先並沒有察覺某一物體,依然能即刻辨認它,這是人類擁有的神奇能力。(即時辨識對我們的進化很重要,因為我們的祖先必須在一瞬間,斷定是否有老虎潛伏於灌木中,甚至在牠們還沒完全看清楚以前。)這是第一次,機器人在一個特定視覺辨識測驗中,得分持續地高於人類。

我與機器人之間的比賽很簡單。首先,我坐在椅子上,目視一個普通的電腦螢幕。然後,一個圖片在螢幕中閃現不到一秒鐘,而我必須儘快按下兩個按鍵之一,表示我有沒有在途中發現一個動物。我必須儘快做決定,甚至在我有機會完全消化這張圖之前。電腦也會針對相同的圖片做出決定。

結果實在夠糗,經過許多快速測驗之後,機器和我的表現幾乎一樣好。但有好幾次機器得分明顯比我高,把我遠遠拋在後面。我被機器打敗了。(當我被告知,電腦答對的次數占82%,人類平均分數只有80%時,我內心略感安慰。)

波吉歐的機器的關鍵是它複製了大自然的經驗。許多科學家都知道這個陳述為真:「輪子既然已經發明,為何不複製它?」例如,通常當一個機器人在看圖畫時,會試圖將它分解為許多系列的線、圓圈、方塊和其他幾何圖形。但波吉歐的程式不同。

當我們看到一個圖畫時,我們先看到不同物體的輪廓,然後看到每一個物體裡面的特徵,然後才是內部的差異等等。所以,我們將影像拆解成許多層。當電腦處理了圖像的一層以後,就將它與下一層整合,以下各層也一樣。用這種方法,一步步,一層層,它模仿了我們的大腦劃分等級處理影像的方法(波吉歐的程式沒有我們認為是理所當然的辨識所有模式的本事,例如物體的 3D 影像、由不同角度辨識千萬種物體等等,但它確實代表模式辨識的主要里程碑。)

後來,我有機會看到「由上而下」和「由下而上」兩種模式的運作。我先飛到史丹佛大學人工智能中心,在那裡我遇見了史丹佛人工智能機器人(Stanford artificial intelligence robot, STAIR )。STAIR 用的是「由上而下」模式,它有四英尺高,有一個巨大的機械手臂,可以旋轉,可以從桌子上抓走東西。STAIR 也可在辦公室或家中移動。這個機器人有一個 3D 的照相機,可以先指定一個物體,將該物體的 3D 影像存進電腦,然後電腦再指引機械手臂去抓物體。自從1960 年代以來,機器人就能像這樣抓住物體,我們在底特律的汽車工廠可以看到他們。

但外表會欺騙人。 STAIR 可以做更多的事。它不像底特律的機器人,不僅僅按照事先寫好的劇本演出。它可以自行運作。如果你要求它撿起一個橘子,它能分析桌上所有的物體,將它們與已經儲存在記憶體中的數千張影像做比對,然後認出橘子,將它拿起來。它也可以透過抓住物體,轉動它們使得指認更正確。

為了測試它的能力,我隨意堆放一些東西在桌上。我說出一個特定物體的名稱,然後觀看結果。我看到 STAIR 正確地分析剛放上去的東西,然後伸手去抓取正確的東西。最終目標,是要讓STAIR巡遊於家中和辦公室環境,拿起不同的東西和工具並與其互動,甚至能以簡單的言語與人對話。如此,它將可做辦公室中任何工友能做的事。STAIR 是「由上而下」模式的一個例子:所有的東西都在開始的時候就以程式存入。(雖然STAIR 能從不同角度辨識物體,但它能辨識的物體數量仍然有限。如果讓它走出室外,讓它隨機辨識物體,它就會癱瘓。)

不久,我有機會訪問紐約大學,數學研究所的電腦學家嚴恩.樂庫(Yann LeCun )在那兒實驗一個截然不同的設計:地面學習機器人(learning applied to ground robots, LAGR )。LAGR 是「由下而上」模式的一個例子:任何事物它都必須嘗試錯誤,從頭學起。它大小與高爾夫球車相當,有兩個立體相機可以掃描地面景物,在前進的路上辨識物體。然後它繞過這些物體,小心不碰到它們,每次通過時都學習到一些。它裝有全球定位系統,也有兩個紅外線感應器,可以偵測到前面的物體。它有三個強力的奔騰晶片,並與一個十億位元的乙太(Ethernet )網路相連。我們到附近的 公園,在那兒 LAGR 可以繞過放在小徑上的障礙物,進行漫遊。每次它通過同樣的路,它都能更快地避開障礙。

LAGR 與 STAIR 的一個重要的不同,在於 LAGR 是特別為學習而設計。每一次碰到東西,它就繞過它,並學習在下一次避開它。STAIR 有成千上萬個影像儲存於記憶體中,而LAGR 的記憶體中幾乎沒有任何影像,取而代之的是創立了一個它所遇到的障礙的心理地圖,並且在每次通過時不斷地修正它。 LAGR 與無人汽車的設計不同,無人汽車事先做了程式設定,並循著預先由 GPS 設好的路線前進;而 LAGR 則是走自己的路,沒有任何來自人類的指令。你只要告訴它去哪裡,它就出發了。最後,像這樣的機器人將會出現在火星、戰場和我們的家中。

一方面,我對這些研究者的熱情和精力印象深刻。在他們心中,他們相信他們正在為人工智能奠定基礎,而他們的工作,有一天會對社會產生我們還沒完全了解的影響。但如眼光放遠,我也可以察覺,他們還有多遠的路要走。即使是蟑螂也能辨識物體,並學習繞過它們。我們仍處於一個連自然所孕育的低階生物,都比我們的多數智能機器人聰明的階段。

不同類型的機器人:LAGR(右上),STAIR(右下),阿西莫機器人(左)。儘管大量增強電腦運算力,這些機器 人的智力只與蟑螂同級。

閱讀完整內容

本文摘錄自

人工智能的未來

big大時商業誌

2019/第31期

相關