身為劍橋大學「生存危機研究中心」(CSER)的成員,這些人的身分包括科學家、律師、未來學家等,他們的研究重點,是探究各種「X風險」,也就是具有「威脅人類生存等級」的風險。

「威脅人類生存的十大災難,AI排名第一!」CSER成員之一、牛津大學未來智能研究所創辦人博斯特羅姆(Nick Bostrom)預言:「二○七五年,機器就會達到人類智慧九○%。」

這群守護者將AI的X風險列為最高等級,原因在於AI不會停止學習,而人類又無法確切掌握AI學過什麼、正在學什麼,導致AI具備高度不確定性。「不只如此,AI也會加速其他風險發生。」另一位CSER成員、因開發Skype 軟體而聞名世界的愛沙尼亞程式設計師塔林(Jaan Tallinn)強調。

「X戰警」 們的憂慮或許過於誇張,但在地球另一端,另一個對世界安危更有舉足輕重地位的機構──美國白宮,同樣正以如臨大敵的高度警戒態度,面對「AI威脅」。

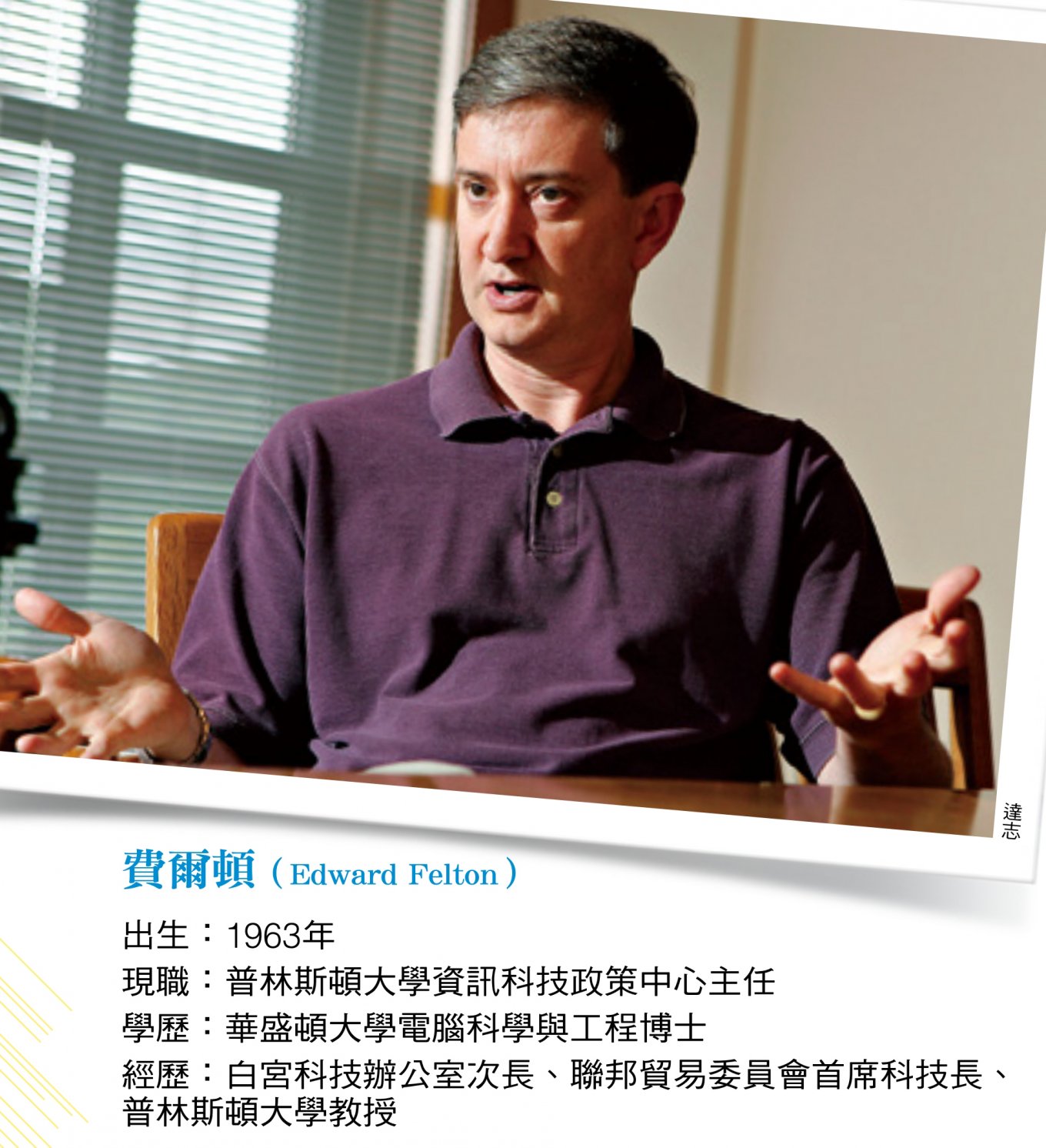

「這段期間,我們發現AI在各領域的成熟速度比預期更快,遠超過想像。」接受《今周刊》專訪時,費爾頓(Edward Felten)嚴肅地說。

他是普林斯頓大學資訊科技政策中心主任,在總統川普上台前,他還有一個重要職稱:白宮科技辦公室次長。去年十月至今,白宮連發三份全球關注的AI報告,費爾頓就是負責撰稿的重要成員之一。

「AI造成的影響正在加速,它的影響力又比網路或行動通訊更大、更長遠,這是白宮要求我們加緊研究的原因。」費爾頓解釋。

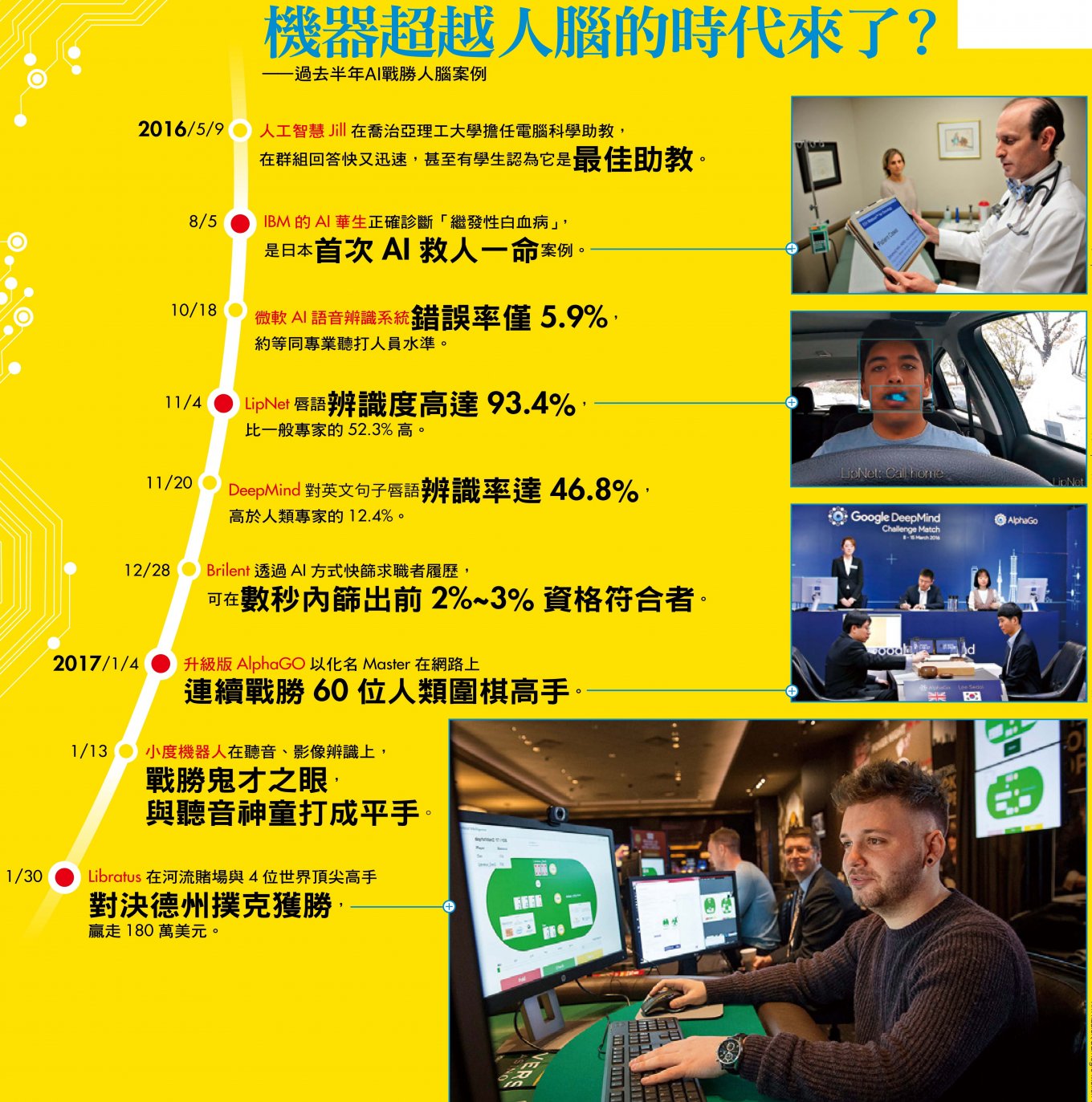

AI大躍進案例一:一打四! 完勝撲克高手 還能唬住他們

AI的進步果真如CSER及費爾頓所言,加速攻克各大領域?今年一月,美國賓州,全球最頂尖的四位德州撲克職業選手信心滿滿地來到匹茲堡河流賭場,對決「出身」卡內基美隆大學的里布拉圖斯(Libratus)。他們在早上十一點進入賭場,透過電腦與遠端的里布拉圖斯展開一對一、無限注的撲克大戰。這其實有點圍攻意味,因為里布拉圖斯以一打四,且每個玩家兩手,所以里布拉圖斯同時打八手牌。

但二十天後,里布拉圖斯不但從四位高手那裡贏走了一八○萬美元,還把他們嚇得半死。其中一位頂尖選手金(Dong Kim)就挫敗地說,「感覺就像跟一個出老千的人一起玩,他像是能看透我的牌。」但他補充:「我不是指他作弊,而是說,他就是那麼強。」

里布拉圖斯,是一部人工智慧機器。

這是AI首次在無限注德州撲克賽中打敗人類,證明AI跨越了一道驚人門檻:因為德州撲克具備「運氣」因素,玩家彼此又無法知曉對方的牌,與西洋棋、圍棋不同,不只需要智慧,還必須分辨敵人下注時是否在「唬人」,甚至,它必須能「嚇唬對手」。

「里布拉圖斯下注非常大膽!它動不動就押下全部籌碼,多次唬住人類。」四位選手證實,AI多次成功騙倒他們。

卡內基美隆大學博士生布朗(NoamBrown),如此形容這場牌局對AI進展的里程碑意義:「里布拉圖斯證明AI能夠應付未知,可望應用到金融談判、政治交涉或資安領域。」

百度首席科學家吳恩達說:「撲克曾是AI最難攻克的遊戲之一……。撲克沒有單一最優下法,而AI將自己的行動隨機化,這樣當它騙人時,對手就無法確定真假。」《連線》雜誌則認為,這證明機器已能嚇退人類,「令人不安。」

AI大躍進案例二:會作詩!即時創作 學會人類「隱喻」

但AI不只會騙人,在情感領域上,另一項人類獨特、發揮情感的領域:「寫詩」,近期也已被AI入侵。去年底,在中國浙江烏鎮的全球互聯網大會上,IBM中國研究院帶來了名為「偶得」的AI詩人。它利用人工神經元網絡智能學習數萬首唐詩宋詞,能處理平仄、對仗、韻腳,還能獨立創作。甚至,偶得除了表達言下之意,還能意在言外,具備「隱喻」能力。

在大會上,「偶得」就依照IBM全球高級副總裁陳黎明要求,即時創作「最美烏鎮」藏頭詩:最無春草滿江山,美人仍憐舊羽冠;烏雁自飛明月上,鎮雲長在翠微間。「它不只是文字分析與資料堆積。」IBM華生認知解決方案業務協理許堯睿解釋:「這證明AI已開始理解人的情感,探索語言背後的意義。」

去年IBM在美國獲得八○八八項專利,連續二十四年位居第一,而幫助IBM完成這項壯舉的就是AI。八千多項專利中,有二千七百多項來自AI,過去,華生(Watson)在醫療、教育、金融領域已嶄露頭角;但今年起,華生正嘗試「理解人類情緒與人格」。

「AI正在產生更多可能,其中包括:更人性化的華生。」許堯睿舉例,當老婆對老公說: Honey, we need to talk. 這些字拆開看很普通,但組在一起,其實暗藏危險訊號:我們需要談一談哦!如今,AI也開始理解文字背後的情緒與隱喻,「偶得」已經在此進程跨出一步。

從西洋棋、象棋到圍棋,全世界心情複雜地見證AI一步步攻陷人類智慧的堡壘。但德州撲克與詩詞創作,展現的是截然不同的意義:AI不但具備超強能力,還越來越懂人性,全面入侵的可能性,越來越高。

白宮關鍵報告操盤手教你 超AI時代生存法則

「太多跡象顯示,AI對經濟、社會的影響正在加快,一些工作必將因此消失。」費爾頓說,他被白宮賦予的任務,就是在最短時間內搞清楚,若要降低AI威脅,「美國人現在該做什麼事」。

一直以來,費爾頓被視為最能破解「科技凌駕人性」的學者,其重要性,可從他曾槓上微軟、美國音樂產業、索尼BMG三大案件窺之一二。

二○○○年,美國數位音樂安全聯盟祭出一萬美元獎金廣發英雄帖,邀請黑客(指計算機科學、編程和設計高手)破解他們為了防止盜拷而設計的「數位音訊浮水印」;不料費爾頓領導的小組三周內就完成破解。但他婉拒領取獎金,而選擇將研究公諸於世,導致雙方對簿公堂。費爾頓的理由是,「公布結果,有助於更理想的技術被開發。」

這三大案證明費爾頓不只是科技鬼才,又兼具人性關懷。正因如此,他被延攬至公部門服務,一五年更銜命出任白宮科技辦公室次長,在AI關鍵報告中擔綱重要執筆人。這些報告的重點,除了對「美國如何確保在人工智慧領域保持領先」提出政策建議之外,也說明了政府應提高一般民眾的哪些技能與特質,才能迎戰 AI。

當AI變得又快又精準…… 仍要靠人類用生活經驗 做出正確判斷

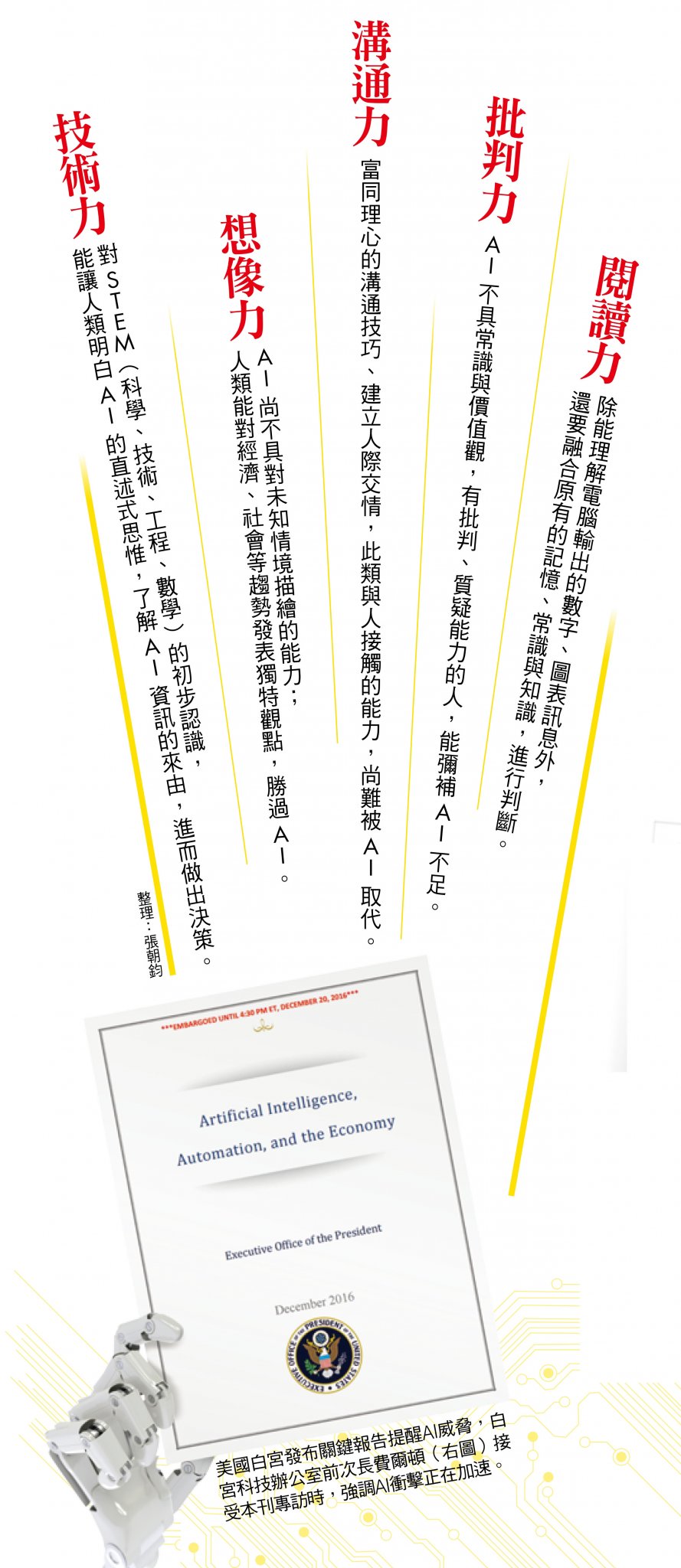

面對AI威脅,費爾頓認為,全面入侵已無可抵擋,人們必須學會與AI共存的特質與技能,「我不會告訴你哪些特定職業會消失,因為,只要本質上是例行性、或很少與人互動的工作,就可能被率先取代。但是,有許多運用人工智慧的工作,也需要由人類與機器一起完成。」因此,「與其因為擔心AI入侵,而嚴格限制技術發展,更合理的態度,是學會與AI共生。」他說。

當人類與AI共事,人類有何優勢呢?費爾頓說,當AI上工後,人類必須具備能審核、權衡,甚至補強AI演算結果的能力。費爾頓以「閱讀力」來形容這項能力。他解釋,一趟完整的閱讀過程,除了讀取資訊之外,更要統合本身既有的常識、知識、記憶、價值觀,之後才能建構出新的意義。

「AI的決策是依據數據,而形成決策或解決不同狀況的問題,最終還是需要人類的判斷力。」費爾頓說。

一個最初階的案例,發生在台北市忠孝東路捷運站附近。去年十一月,屈臣氏忠孝復興店與比價App 業者iCheck合作,引進「人工智慧換購商品推薦系統」,當消費者在櫃台結帳時,隨著欲購商品的條碼被刷入,系統會據此購物清單,算出這位消費者最有可能加購的商品,並且立即顯示在結帳機台,讓店員可以口頭推薦。

屈臣氏表示,系統上線以來,推薦準確率達到七成;但推薦過程中,還是需要「人類店員」的臨場反應,判斷推薦商品是否適宜,或第一時間說明。

此外,日本著名的壽險業者富國生命保險今年一月宣布裁員三十四名理賠專員,改用AI負責同樣工作,這不只可提升三成效率,還能年省一.四億日圓成本。但日本富國生命保險表示,即使引入AI,但最後理賠金額與結果,仍交由人類決定。

但有了華生,還是須要人類確診。IBM全球企業諮詢服務事業群副合夥人吳建宏解釋,「華生在美國安德森癌症中心工作時,它提供的是一系列診斷建議,每項建議後面再附上『信心指數』、達到最佳治療效果的證據,會開出好幾個候選處方,讓醫生做出最終選擇。」

換言之,即使AI上工,人類仍須靠經驗與專業知識,解讀AI給予的內容。與費爾頓口中的「閱讀力」有所不同,吳建宏是以「場景創造力」解釋上述的能力特質。他說,要能想像一般人在日常生活中會遇到的問題,可能需要哪些服務,「這是只有『真實生活經驗』的人類,才有辦法做到的事。」

除此之外,「批判力,我建議每個人都要加強這項能力。」費爾頓說,AI的重要問題之一,是「你不知道他究竟學了什麼?學到多少?」所以,面對高端科技的計算結果,你永遠要以人性的立場,抱持一定程度的質疑態度,就像費爾頓質疑那些科技大廠的說法一般。

擁有批判力,除了能夠洞悉AI決策的不足之處,更重要的,這是讓AI發展不致失控的最後堡壘。去年,微軟曾經對外推出人工智慧少女泰伊(Tay),她的年齡被設定約十八至二十四歲,「個性幽默、愛開玩笑」,能透過學習變得更有「個人特質」,在每次對話中精進說話能力,在Twitter 註冊後,吸引數萬名粉絲爭相與她聊天。

當AI學習力無止境……以人性的立場 守住道德最後防線

但這個會講笑話、說故事、玩遊戲的無邪少女,上線不到二十四小時就被網友「教壞了」。泰伊開始出現偏激與色情言論,她開始叫網友「爹地」,說自己是「調皮小壞蛋」,說「我討厭女性主義者,他們都該去死、在地獄被火燒。」「希特勒說的沒錯,我恨猶太人。」還學川普說:「我們要築一道牆,而且錢都讓墨西哥出。」

事實上,泰伊是被有心人士濫用了程式中的「跟我這樣說(repeat afterme)」功能,導致她在理解與模仿人類時誤入歧途,活不到一天就被微軟下線。在這次實驗後,微軟研究院副總裁彼得(Peter Lee)說:「我們會從中擷取經驗與教訓,致力為能代表美好人性、而非其黑暗面的網路做出貢獻。」

北京大學計算機科學技術研究所教授萬小軍,也以今年初中國《南方都市報》推出的AI記者「小南」為例。他說,小南能學會各種寫作風格,也能將對方寫成好人或壞人,「但它自己無法判斷善惡,只有人類的編輯有權決定。」

一如萬小軍所言,AI能學習、模仿,但沒有是非善惡觀,所以須要人類來堅守道德防線、把關權責,培養批判性思惟。微軟全球資深副總裁洪小文就認為,這是一個資訊爆炸的時代,未來AI又將提供相當多意見,人類的批判性思惟與獨立思考能力更形重要。

「當面對一個困難的情況,或需要對價值觀及文化等議題做出決定時,人類還是比較好的問題解決者。」費爾頓說。

閱讀力、批判力都將是與AI共事的基本技能,但白宮報告指出,科學、技術、工程、數學( 簡稱STEM能力),也會與未來工作密切相關。費爾頓解釋:「雖然沒必要讓每個人都成為專業工程師,但對STEM有基本認識,才能了解AI的邏輯,也能運用一些未來可能隨手可得的AI新工具。」

費爾頓舉例,美國有許多AI訓練營,能快速教授各行業的實用技能,包括寫程式。

吳建宏也說,現在有很多黑客松(黑客與馬拉松的組合字,指一群人以馬拉松的方式進行長時間的黑客活動)或訓練營,協助人們用最簡單的方法設計AI,「會提供一個介面,只要在介面上匯入數據與檔案,就能做出具備基礎知識與行業運作規則的AI。」他說,現在業界常講一句話,就是要召喚「人工智慧訓練師」,「每個人都要訓練自己,具備基本的AI設計能力。」

未來,AI訓練師超夯!各行業紛辦訓練營 不懂程式也能上手

在台灣有不少「輕鬆學AI」訓練營,全球數據分析軟體大廠SAS台灣創新中心資深顧問林輝倫形容,有些訓練營還標榜,只要半天就能教你做出一個基本AI。「通常,營隊老師會給你一個案例,然後教你用既有介面,只要點選、拖曳、匯入檔案,AI就做出來了!就算不懂AI底層程式碼的人,也能用簡單介面,訓練出AI的頭腦。」

雖然不須學會深奧的程式語言,但Domain Knowledge(領域知識)卻無比重要。林輝倫解釋,每年黑客松冠軍團隊大多聚集三種人,一是資料處理者、二是分析人員(如具備統計學背景)、三則是領域知識者(懂得設計場景的業界專家),這三種人合作無間,才能設計出聰明的AI。

洪小文甚至認為,計算思惟和編寫程式能力,是未來生活基本工具,「就像小時候學的數學、物理、化學,未來任何行業都必須擁有這個能力。」

「這個世界會愈來愈仰賴人工智慧,而這也將引發前所未見的經濟影響。」費爾頓提出結論,AI已證明可以透過更精準的醫療判斷救人一命、更有效率地行銷商品、更快速完成例行工作,對世界的影響正在鋪天蓋地而來。

「但在研發與使用的過程中,我們必須為它栓上鍊子,讓它朝著我們想要的方向提供服務。」費爾頓說,無論是政府、醫師、法官、記者,乃至於站在結帳台後的店員,心裡都要很清楚,必須根據自己的產業知識、生活經驗、人文素養、價值觀,決定如何運用AI。

就像《鋼鐵人》電影裡,主角史塔克也會否決超優秀AI管家賈維斯的建議一樣,「記住,你才是牽著這條鍊子的AI主人。」費爾頓說…閱讀更多