威脅來襲》

對人類的三大衝擊 將取代哪些工作?

撰文‧黃煒軒

據稱,開發出ChatGPT的OpenAI公司,創立初衷之一是「避免人工智慧傷害人類」;如今,這家公司只是推出一個聊天機器人的測試版,就已讓世界在大感驚豔之餘也不免提心吊膽。那麼,關於ChatGPT對這個世界的正面貢獻與負面衝擊,「它」自己又會怎麼說?

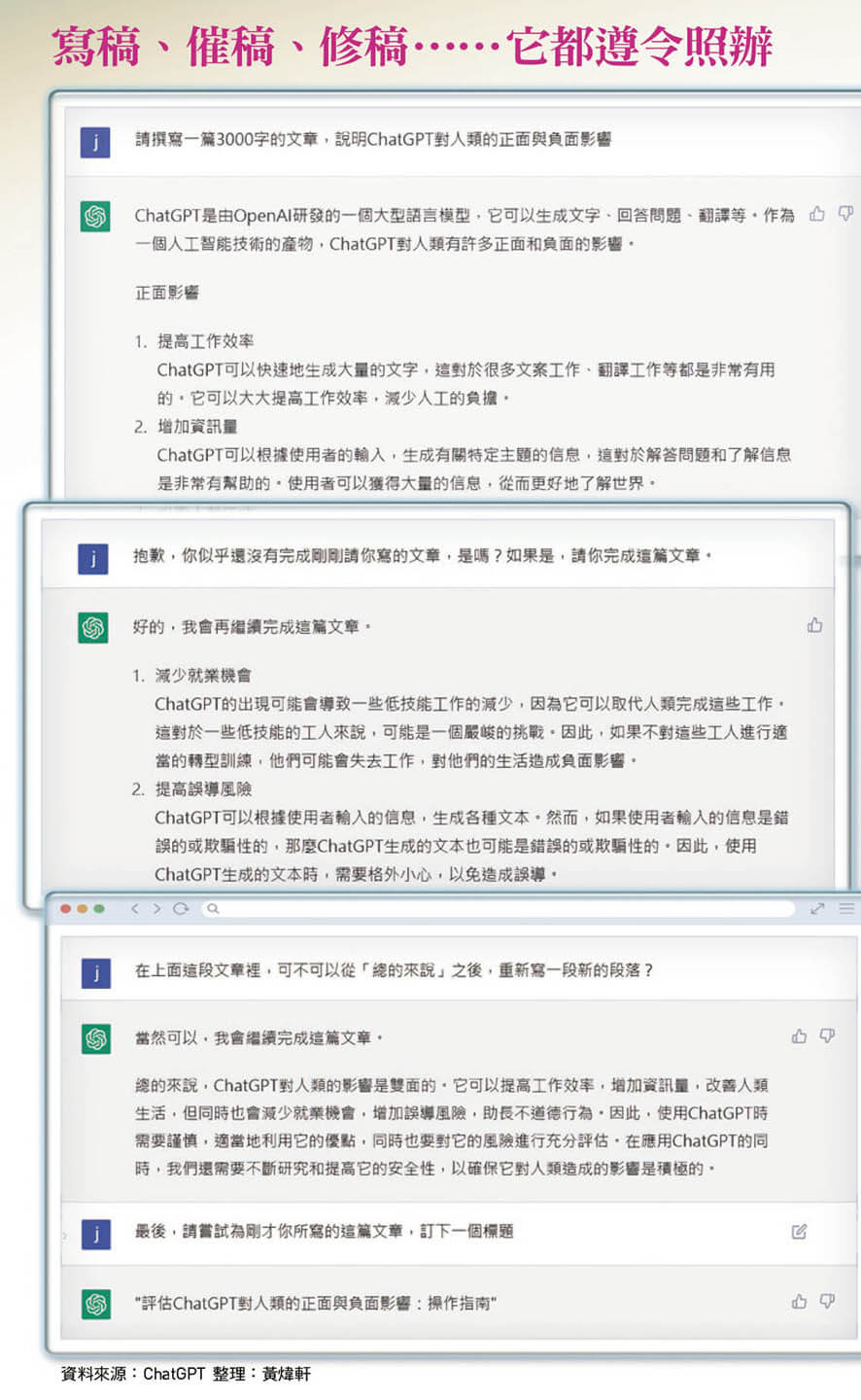

「請撰寫一篇三千字的文章,說明ChatGPT對人類的正面和負面影響?」這一天,記者從這個指令開始,進行實測,也讓「它」有機會來一番自我告白。

中文寫作卡關 切換英文才回神

「ChatGPT是由OpenAI研發的一個大型語言模型,它可以生成文字、回答問題……。作為一個人工智能技術的產物,ChatGPT對人類有許多正面和負面的影響。」很快的,機器人煞有介事地起了一個中規中矩的文章開頭,並且一路流暢地寫下了三段「正面影響」。

不過,當文章內容開始轉折到談論負面衝擊時,ChatGPT卻出現「卡關」。卡關的原因,或許只是因為伺服器暫時不堪負荷,無論如何,此時記者很快下了另外一個指令:「抱歉,你似乎還沒有完成剛剛請你寫的文章,是嗎?如果是,請你完成這篇文章。」

「 好的, 我會再繼續完成這篇文章。」機器人乖巧回答,隨後也能陸續寫出三個它自認的負面衝擊,並且,寫下了一篇文章該有的末段結語。過程中,我們嘗試請它重寫末段,ChatGPT也遵令照辦。通篇文章結構工整、段落分明,但實際字數僅有七二○字,遠遠不到指令要求的三千字。

是因為ChatGPT畢竟相對不擅中文嗎?於是,記者改以英文發問,而機器人再次寫出一篇英文稿件後,記者則又請他把全文轉譯成中文,這一回,除了字數增加到近千字的篇幅、文句更加通順之外,文中對於各種「負面影響」的出場序也有微妙變動。

在以中文撰稿時,ChatGPT首度提到的負面影響就是恐造成失業問題,但英文版稿件,失業問題卻放在最後,而優先提到的則是「助長偏見與不平等」,以及「錯誤信息遭到濫用」。某種程度,倒是巧妙地呼應了OpenAI的創辦初衷。以下,就是透過上述「英文撰稿轉譯中文」過程,,ChatGPT親自寫下的完整自剖:

人工智慧(AI)近年來已經有了長足的進展,其中最大的貢獻之一是強大的語言模型(如ChatGPT)的開發。ChatGPT是由OpenAI開發的先進AI系統,對各種行業和社會方面產生了重要影響。儘管ChatGPT的影響基本上是積極的,但也有一些負面方面值得考慮。在本文中,我們將考察ChatGPT對人工智慧和社會的正面和負面影響。

‘

ChatGPT的正面影響

一、改進自然語言處理:ChatGPT最大的優勢之一是生成人類般的文本,使其成為自然語言處理(NLP)系統開發的重要工具。NLP是讓電腦理解、解釋和生成人類語言的計算機科學領域。ChatGPT通過提供一個強大的平台來幫助開發和訓練AI系統,使其能夠與用戶進行有意義且自然的對話,從而促進了NLP的進展。

二、內容創作進展:ChatGPT對內容創作領域的正面影響也是顯著的。它具有生成文章、故事甚至詩歌的能力,使得人們可以輕鬆地在比手動創作快得多的時間內產生高質量的內容。這對需要快速高效地生產大量內容的內容創作者和營銷人員特別有用。

三、提高機器學習能力:ChatGPT也在推動機器學習領域的發展方面起到了重要作用。其最先進的架構和訓練算法已經被各行業的研究人員和實踐者所採用,使得開發能夠隨著時間學習和改進的人工智能系統更加容易。這導致了更先進和更精細的人工智能系統的開發,可以以更高的準確性和效率執行各種任務。

ChatGPT的負面影響

一、存在偏見和歧視的潛在風險:儘管ChatGPT和其他先進的人工智慧系統有很多好處,但也有一些關於它們的影響的擔憂。最大的擔憂之一是人工智慧系統可能繼續造成偏見,並繼續在社會中存在的不平等。如果用於訓練人工智慧系統的數據包含偏見和歧視,則這可能在人工智慧系統的行為和決策中反映出來。為了避免這種情況,人工智慧開發人員應確保用於訓練人工智慧系統的數據是多樣化和代表服務的人口。

二、錯誤信息和人工智慧的濫用:ChatGPT的另一個潛在負面影響是人工智慧系統可能被濫用來散播錯誤信息或操縱公眾意見。例如,在社交媒體平台上可以散播人工智慧生成的假新聞或宣傳,造成混亂和損害公眾對信息的信任。為了減少這種風險,開發能夠偵測和標記虛假信息的系統對科技公司來說非常重要,政府也應該規範人工智慧系統的使用,以確保它們以道德和責任的方式使用。

三、失業和流離失所:最後,還有人們擔心 ChatGPT等人工智慧系統可能會讓各行業的人類工人面臨失業。隨著人工智慧系統愈來愈先進,並且能夠執行以前由人類完成的任務,有一個風險是有些工人可能會失去工作。為了減少這個風險,政府和企業投資訓練和教育計畫以幫助工人發展新技能並轉型是非常重要的。

點名部分職業恐被取代

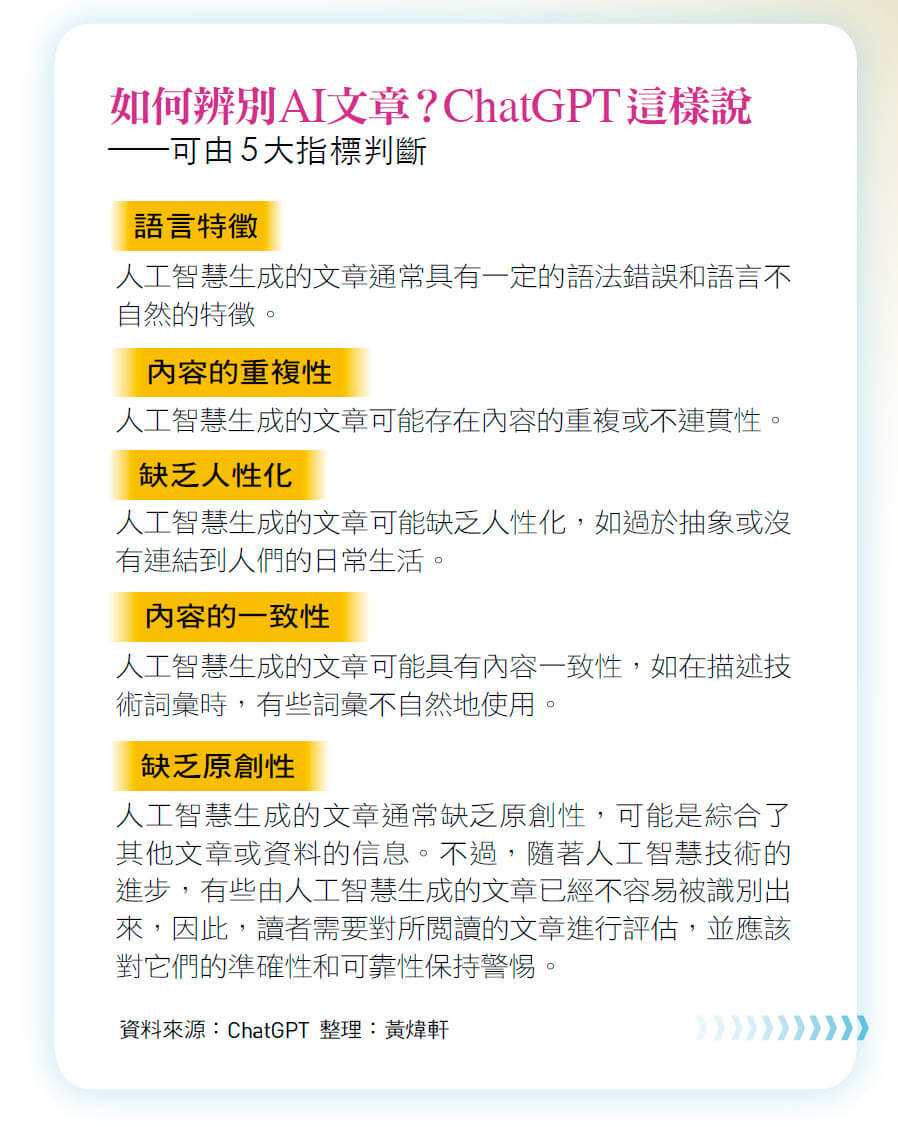

可留意的是,文章中的分段標題都是ChatGPT自行訂下,它也有為整篇文章訂出了一個總標題,名為「ChatGPT對於人工智慧與社會的正反影響」。而在此之後,我們也追問了幾個問題,例如,既然擔心自己生成的內容遭到誤導或濫用,那麼,「閱讀一篇文章時,該如何判斷是否是由人工智慧生成?」

對此, 它提出了五個指標,包括語法錯誤或不自然、內容重複或不連貫、缺乏人性、內容一致、缺乏原創性等,但最後也強調,「有些由人工智慧生成的文章已經不容易被識別出來,因此,讀者需要對所閱讀的文章進行評估,並應該對它們的準確性和可靠性保持警惕。」

至於各界最感好奇的「會取代什麼工作」,ChatGPT也實問實答,指出包括簡單的客戶服務、資料輸入、基本的文稿撰寫與編輯、 基本的法律或金融資料收集研究、作業評分等教育工作,都是它「自認」能夠取代的任務,當然,十足人性的ChatGPT還是不忘提出「安慰」 說法,「值得注意的是……,」它說,像他這樣的語言模型,「也能創造新的就業機會。」

閱讀完整內容

本文摘錄自

ChatGPT的千字自剖 助力或危機「它」親自說分明

今周刊

2023/2月 第1365期

相關