比AlphaGo下圍棋複雜千萬倍

當AI遇上電競,不只是一場機器人與人類的競賽。AI可以透過自主學習,開發出新戰法協助訓練選手,而高度複雜的遊戲也能幫助AI更精準。

從信心滿滿到麻木絕望, 這是有「不敗少年」之稱的南韓棋士李世乭,在2016年與Google開發的人工智慧AlphaGo對弈的心情轉折。

從李世乭敗給人工智慧(AI)開始,一般大眾逐漸正視AI的潛在發展性,而相較於雙方都能掌握賽局全面資訊的圍棋,在電競中,因為僅能掌握視野裡的片段訊息,且是動態進行、反應時間短暫、複雜度遠遠高出許多,這也是為什麼像DeepMind、OpenAI這些人工智慧公司都紛紛將AI與電競結合,不論是訓練選手,或是擊敗選手,AI讓我們看見電競的另一種可能。

今夏挑戰團體戰,OpenAI再度獲勝

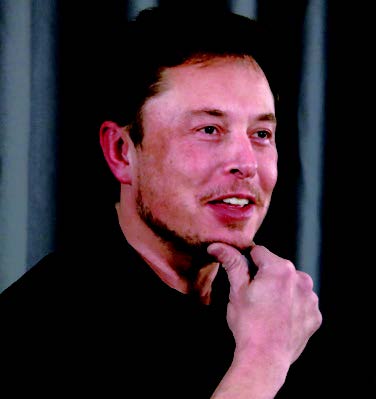

「如果你不關心AI的安全性,現在應該要這麼做,AI造成的威脅比北韓更高。」特斯拉執行長馬斯克(Elon Musk)會這麼說,是因為由他創辦的非營利人工智慧組織OpenAI,開發出的AI機器人,2017年成功在電競遊戲《Dota 2》中擊敗人類選手。

OpenAI技術長葛瑞格.布洛克曼(Greg Brockman)表示,OpenAI完全是透過自學,訓練出一套專屬的戰略玩法,且整個訓練過程僅花了兩周,賽後馬斯克表示,「這是OpenAI首次在比圍棋更複雜的電競項目中擊敗人類。」一席話暗指OpenAI的成就勝於AlphaGo。

不過這麼說或許不全然公平,曾在Google大腦團隊工作過的研究員丹尼.布里茲(Denny Britz)認為,OpenAI擊敗人類並沒有實質上的重大突破,因為這場比賽採一對一的模式,並非一般電競比賽的多人團體戰,在戰術規劃、協作能力等,複雜度根本不能相比。

此外,OpenAI是由《Dota 2》的API(應用程式介面)製作,因此機器可以事先掌握像是準確攻擊距離數值,這些人類選手無法得到的遊戲資訊,因此在基礎上本身就不公平。布里茲認為AI並未有突破性的進展,只是研究人員用正確的方式繞過現有技術的限制來解決問題,並直言AI要在電競中擊敗人類,還需要至少一、兩年的時間。

然而OpenAI採自主學習模式,有可能發展出人類不曾使用的玩法,而最終人類可以向AI選手學習新的戰略玩法,來精進自己的技能。2018年六月,OpenAI團隊已經成功製作一款能夠在《Dota 2》中以「團體戰」形式,擊敗5名頂尖業餘玩家的AI軟體「OpenAI Five」;AI與AI之間能夠相互配合,被認為是電腦科學領域的新里程碑。

既能給人類新戰略,也能讓AI更聰明

就在擊敗李世乭後,Google的A I 團隊DeepMind與暴雪娛樂(Blizzard Entertainment),於2017年合作一項結合遊戲《星海爭霸 2 》的研究計畫,不過跟OpenAI與人類競賽的目的不同,DeepMind是要把遊戲當成訓練AI的工具,讓AI變得更聰明、更精準。

《星海爭霸2》是專業電競比賽中的比賽項目之一,是一款高度複雜的遊戲,玩家必須兼顧建構防禦、採集資源、發展武器等工作,任務複雜且多樣,不同玩法也會導致不同的結果。

看中這款遊戲的複雜性,DeepMind推出將《星海爭霸2》用於訓練AI的介面API,資料庫中集合了高達6萬5千場的電競比賽影像,讓AI學習人類的戰術,團隊也將遊戲中的特定元素,像是地圖探索、資源收集分拆出來,讓AI可以針對弱項單獨訓練,並將這些數據反饋給研究人員。

DeepMind研究員奧里歐.凡尼爾斯(Oriol Vinyals)認為,比起圍棋,《星海爭霸2》的複雜度更接近現實生活中的情況。圍棋落點的可能性是10的170次方,而《星海爭霸 2 》的複雜度至少要再加上100個零,不過目前AI在《星海爭霸 2 》的探索仍處在早期階段,反應能力仍不夠準確。

然而透過DeepMind、OpenAI的例子,已可以看到「AI+電競」邁出關鍵性一步,不論是用來訓練選手,或測試新的AI技術,也許未來AI科學家可以跟遊戲發行商合作,在高度複雜的遊戲中,結合AI科技來提升遊戲本身以外的價值,加速AI整體發展速度。或許正如同DeepMind顧問大衛.邱吉爾(David Churchill)說的:「我們正在替未來可以用於真實世界的科技,打造一個測試的溫床。」…閱讀完整內容

OpenAI

成立年|2015年

創辦人| 伊隆.馬斯克(Elon Musk)、山姆.奧爾特曼(Sam Altman)

業務內容|非營利人工智慧研究機構